本周,智能汽車領域最引人注目的焦點,無疑再次聚焦于特斯拉及其備受爭議的Autopilot系統。隨著特斯拉CEO埃隆·馬斯克多次公開宣稱其全自動駕駛(FSD)能力“即將實現”,并將其與行業最高等級的L5級自動駕駛相提并論,業界與公眾的質疑聲浪也愈發高漲。本期智能汽車周報,我們將深入探討特斯拉Autopilot的技術現狀,并解析當前智能聯網汽車相關技術研究的真實進展與核心挑戰。

一、 Autopilot的“承諾”與L5的“現實”鴻溝

特斯拉的Autopilot及FSD(全自動駕駛)套件,無疑是目前量產車中最為激進和知名的輔助駕駛系統。它基于純視覺感知方案,通過遍布車身的攝像頭收集數據,依靠強大的神經網絡進行實時環境理解和決策。馬斯克曾多次表示,特斯拉已經具備了實現L5自動駕駛(即完全自動駕駛,無需人類干預,可在任何條件下運行)的硬件基礎,只待軟件算法的最終完善與監管批準。

現實情況卻復雜得多。根據國際汽車工程師學會(SAE)的定義,L5級自動駕駛意味著車輛可以在人類駕駛員能夠處理的所有道路和環境條件下,完成全部駕駛任務。這要求系統具備近乎無限的“場景泛化能力”,能夠應對極端天氣、復雜未知路況、模糊不清的交通指示等“長尾問題”。目前,包括特斯拉在內的所有廠商,其系統本質上仍屬于L2(部分自動化)或有限條件下的L3(有條件自動化),需要駕駛員保持注意力并隨時準備接管。近期發生的一系列與Autopilot相關的事故調查,也凸顯了系統在識別靜止物體、施工區域、異形車輛等方面的局限性。業內普遍認為,從技術驗證、安全冗余、法規倫理到基礎設施配套,實現真正的L5仍是一條漫長而艱難的道路。特斯拉的“吹噓”更多是技術路線的宣傳與數據積累的驅動,而非即刻可交付的現實產品。

二、 技術路徑之爭:視覺派 VS 多傳感器融合

特斯拉堅持的純視覺路線,與行業內主流的“激光雷達+毫米波雷達+攝像頭”多傳感器融合方案形成了鮮明對立。特斯拉的邏輯在于,人類僅靠雙眼就能駕駛,因此通過足夠先進的AI算法和海量的真實道路視頻數據訓練,攝像頭理應足以勝任。這種方案成本較低,更易于大規模部署。

但反對者認為,攝像頭在逆光、雨霧、黑夜等惡劣條件下的感知能力會大幅下降,且缺乏精確測距能力。激光雷達能提供精確的三維點云圖,毫米波雷達則不受天氣影響,多傳感器融合能提供更高的安全冗余和可靠性,尤其是在應對“長尾”極端場景時。目前,Waymo、Cruise以及中國的蔚來、小鵬、理想等廠商,均采用了融合方案。這場路徑之爭的結局,或許并非一方徹底勝出,而是根據不同應用場景(如Robotaxi、私家車、貨運)分化發展。

三、 智能聯網汽車技術研究前沿動態

拋開L5的遠景,本周智能聯網汽車領域的研究與落地應用仍在穩步推進:

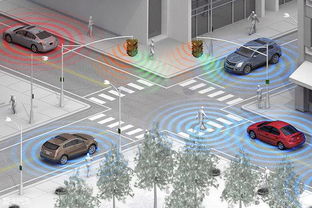

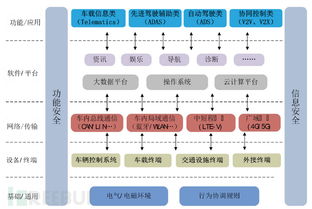

- 車路云一體化協同成為新熱點:單一車輛的智能存在天花板。中國正在大力推進“車路云一體化”發展路線,通過5G-V2X(車用無線通信技術)讓車輛與道路基礎設施(如信號燈、路側感知單元)、其他車輛以及云端平臺實時通信。這相當于為單車提供了“上帝視角”和超視距感知能力,能有效彌補單車智能的不足,提升交通效率和安全性。本周,多個城市擴大了智能網聯汽車示范區的范圍。

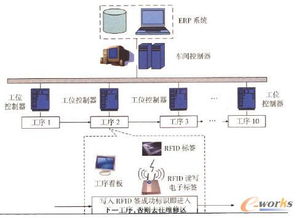

- 艙駕一體與中央計算平臺:電子電氣架構從分布式向域控制、最終向中央計算平臺演進是必然趨勢。本周,芯片廠商如英偉達、高通,以及車企紛紛發布新一代高性能計算平臺,旨在將智能座艙(信息娛樂、人機交互)與智能駕駛的計算任務整合,實現硬件資源的高效共享和軟件功能的快速迭代,為用戶提供更無縫的智能體驗。

- 大模型上車:生成式AI和大語言模型(如GPT系列)的技術浪潮開始席卷汽車行業。研究重點在于如何讓汽車擁有更自然、更擬人、更懂用戶需求的交互能力,以及利用大模型強大的理解與生成能力,優化感知、預測和決策算法。例如,通過視覺大模型更好地理解復雜交通場景中各類參與者的意圖。

- 數據與安全成為雙刃劍:智能汽車的進化極度依賴數據驅動,尤其是影子模式采集的海量真實道路數據。但數據合規、隱私保護以及網絡安全(防止車輛被黑客遠程操控)已成為全球監管機構和企業必須直面的核心挑戰。本周,相關數據安全管理辦法的討論持續升溫。

特斯拉Autopilot引發的L5級自動駕駛討論,更像是一個吸引眼球的行業“爆點”。它揭示了公眾對終極自動駕駛的迫切期待與技術現實之間的巨大落差。真正的智能汽車革命,是一場需要整車智能、道路智能、云端智能協同推進,并在安全、法規、倫理框架內穩步前行的系統工程。告別“吹牛”與炒作,回歸扎實的技術演進與可靠的場景落地,才是行業健康發展的正道。下周,我們將繼續關注芯片算力競賽與城市NOA(導航輔助駕駛)的落地進展。